苏纳克在AI峰会上警告:人工智能可能给人类带来与核战争规模相当的风险

11月1日,首届全球人工智能(AI)安全峰会在英国拉开帷幕,为期两天的会议在布莱切利庄园举行。据英国《卫报》最新消息,英国首相苏纳克2日在会议期间警告说,AI可能会给人类带来与核战争规模相当的风险。

苏纳克在首届全球人工智能(AI)安全峰会会议期间警告称,人工智能可能给人类带来与核战争规模相当的风险 图自天空新闻网

《卫报》称,苏纳克表示,他对先进的AI模型给公众带来的风险感到担忧。报道说,这与该领域内一些资深人士最近发出的警告相呼应。

“开发这项技术的人们已经提出了AI可能带来的风险,重要的是不要对此过于危言耸听。关于这个话题存在争议。业内人士对此看法并不一致,我们也无法确定。”苏纳克告诉记者,“但有理由相信,它可能会带来与大流行病和核战争规模相当的风险,这就是为什么,作为领导人,我们有责任采取行动,采取措施保护人民,这正是我们正在做的事情。”

报道说,苏纳克希望获得包括美国、欧盟、日本和加拿大在内的多国政府同意,就如何在AI工具发布之前进行合作、以测试其安全性达成协议。

报道还提到,苏纳克的话呼应了美国企业家马斯克的说法。马斯克在11月1日的会议上表示,人工智能是“对人类最大的威胁之一”。

《卫报》提到,此次峰会开始时,正式发表了一份由英国、美国、欧盟和中国在内的28个政府达成的《布莱切利宣言》,这是全球第一份针对人工智能这一快速新兴技术的国际性声明,旨在关注对未来强大人工智能模型构成人类生存威胁的担忧,以及对人工智能当前增强有害或偏见信息的担忧。

(环球网/张晓雅)

苏纳克在AI峰会上警告:人工智能可能给人类带来与核战争规模相当的风险

11月1日,首届全球人工智能(AI)安全峰会在英国拉开帷幕,为期两天的会议在布莱切利庄园举行。据英国《卫报》最新消息,英国首相苏纳克2日在会议期间警告说,AI可能会给人类带来与核战争规模相当的风险。

苏纳克在首届全球人工智能(AI)安全峰会会议期间警告称,人工智能可能给人类带来与核战争规模相当的风险 图自天空新闻网

《卫报》称,苏纳克表示,他对先进的AI模型给公众带来的风险感到担忧。报道说,这与该领域内一些资深人士最近发出的警告相呼应。

“开发这项技术的人们已经提出了AI可能带来的风险,重要的是不要对此过于危言耸听。关于这个话题存在争议。业内人士对此看法并不一致,我们也无法确定。”苏纳克告诉记者,“但有理由相信,它可能会带来与大流行病和核战争规模相当的风险,这就是为什么,作为领导人,我们有责任采取行动,采取措施保护人民,这正是我们正在做的事情。”

报道说,苏纳克希望获得包括美国、欧盟、日本和加拿大在内的多国政府同意,就如何在AI工具发布之前进行合作、以测试其安全性达成协议。

报道还提到,苏纳克的话呼应了美国企业家马斯克的说法。马斯克在11月1日的会议上表示,人工智能是“对人类最大的威胁之一”。

《卫报》提到,此次峰会开始时,正式发表了一份由英国、美国、欧盟和中国在内的28个政府达成的《布莱切利宣言》,这是全球第一份针对人工智能这一快速新兴技术的国际性声明,旨在关注对未来强大人工智能模型构成人类生存威胁的担忧,以及对人工智能当前增强有害或偏见信息的担忧。

(环球网/张晓雅)

李若鹏任副市长

李若鹏任副市长 李红利任市委组织部部长

李红利任市委组织部部长 “钱龙”游巴山民俗表演与摘“恩桃er”活动同步“五一”震撼来

“钱龙”游巴山民俗表演与摘“恩桃er”活动同步“五一”震撼来 四川宣汉的一角美得嗨翻天啦

四川宣汉的一角美得嗨翻天啦 旌阳双东通江凯江河两岸春色美!

旌阳双东通江凯江河两岸春色美! 教材课本封面的宣汉版来啦

教材课本封面的宣汉版来啦 直击武警特战实战化反恐演练

直击武警特战实战化反恐演练 组图2024首场雪景天安门之美

组图2024首场雪景天安门之美 龙系列黄金姓氏创意

龙系列黄金姓氏创意 带您提前欣赏春节达州城市美景

带您提前欣赏春节达州城市美景

“陌生人”突然狂批4分钟,民进党掐直播!

“陌生人”突然狂批4分钟,民进党掐直播! “台军演习全副武装在沙滩练冲锋……”

“台军演习全副武装在沙滩练冲锋……” 韩系简约少女写真图集韩系简约少女写真图集

韩系简约少女写真图集韩系简约少女写真图集 最浪漫的事,就是和你一起在翡翠谷过七夕

最浪漫的事,就是和你一起在翡翠谷过七夕  习近平

习近平 五角大楼官员承认:“没起作用”

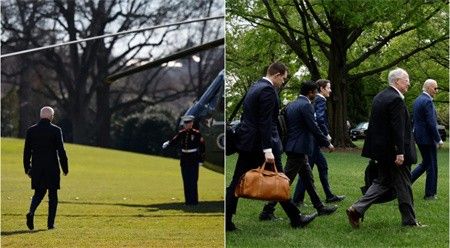

五角大楼官员承认:“没起作用” 怕被别人看出来,拜登想了个办法

怕被别人看出来,拜登想了个办法 世界新闻网官宣!他们“最美”

世界新闻网官宣!他们“最美” 宣汉县政府廉政工作会议召开

宣汉县政府廉政工作会议召开